Deepfake – inte bara metod i krigföring, kan även drabba chefer

Under kriget i Ukraina har världen kunnat se hur ett så kallat deepfake-klipp med president Volodymyr Zelenskyj har spridits. Nu varnar amerikanska FBI att även högt uppsatta chefer och ledare kan drabbas av bedrägerier genom den senaste tekniken.

Deepfakes, när det med hjälp av den senaste tekniken skapas falskt rörligt material, där en persons identitet kapas för att driva fram en viss agenda aktualiserar frågan om vår tilltro till det rörliga. Genom att omvandla ljud till läpprörelser på en filmad person kan man både få det att låta och se ut som att en person säger något. För att lyckas åstadkomma detta behövs inte ens äkta ljudfiler!

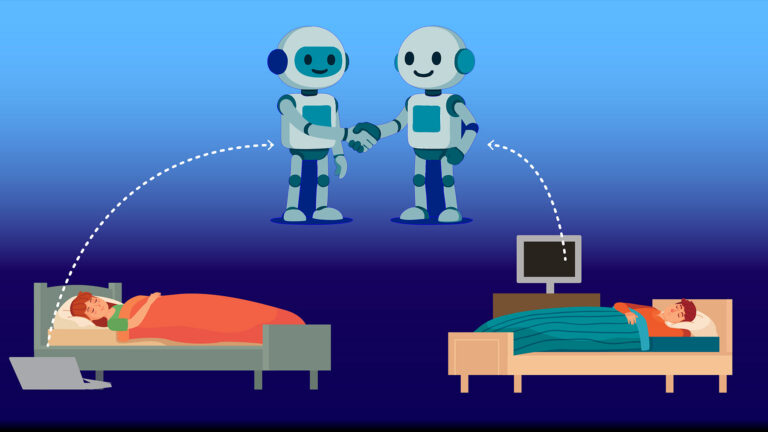

För dig som chef kan det bli aktuellt om cyberkriminella lyckas kapa e-postkonton och därigenom får tillgång till plattformar där många har vant sig vid att arbeta och ta emot instruktioner. Med ett kapat konto menar FBI att chefer kan bli utsatta genom att medarbetare exempelvis bjuds in till ett virtuellt möte. Väl i mötet möts kollegorna av en bild på vd:n utan ljud eller förfalskat ljud som låter som vd:n. ”Vd:n” hävdar att video eller ljud inte fungerar korrekt och instruerar deltagarna att göra en överföring av pengar. Det kan göras i möteschatten eller i ett uppföljande e-postmeddelande.

En annan potentiell situation som FBI listar är att en hackare kapar en anställds inkorg och spionerar på virtuella företagsmöten för att samla information om den dagliga verksamheten. Den informationen kan sedan användas i efterföljande vd-bedrägerier. Ett tredje scenario som listas är att en angripare kapar vd:s e-postkonto och skickar instruktioner om överföringar samtidigt som de hävdar att de inte kan göra det själva för att de är upptagna i ett virtuellt möte.

Det första exemplet är likt det som världen fick se i krigföringen mellan Ryssland och Ukraina, så kallad deepfake där man lyckas förställa ljud och bild på ett ofta mycket trovärdigt sätt. Det finns exempel på när man genom det här tillvägagångssättet har kunnat lura offer att göra överföringar av miljontals dollar. Bland annat lyckades bedragare få en bankchef i Förenade Arabemiraten att göra en överföring på 35 miljoner dollar efter att en icke namngiven kund fått sin röst förfalskad.

Peter Gustafsson, ansvarig för Barracuda Networks verksamhet i Norden, beskriver det ovan nämnda exemplet som ovanligt i dagsläget och att det sannolikt hade kunnat hindras med mer kunskap, men poängterar att det gäller att vara vaksam och hänga med i den tekniska utvecklingen.

”Deepfake-tekniken förbättras hela tiden. Samtidigt sjunker priset till en punkt då deepfake kan bli ett vanligt verktyg för cyberkriminella. För att öka motståndskraften att känna igen och stå emot den här typen av angrepp krävs en kombination av modern teknik och löpande utbildning”, säger han.

Peter Gustafssons tips

Bedragarna anpassar sig hela tiden och finner nya vägar. För att undvika råka ut för bedrägerier ger Peter Gustafsson tips på olika åtgärder som kan minska riskerna.

Utbildning

Se till att skapa och underhålla medarbetarnas medvetenhet om vd-bedrägerier. Ha det som en stående del i utbildningar och genomför simulerade attacker. En större kunskap om vd-bedrägerier kan också bidra till att minska risken för kontostölder.

Processer

Se till att ingen enskild anställd kan godkänna större överföringar av pengar. Det säkerställer att ingen enskild medarbetares okunskap kan orsaka stor skada.

Teknik

Använd en lösning för e-postsäkerhet som utnyttjar AI för att övervaka e-posttrafiken. Då blir det enklare att upptäcka mönster och beteenden som är misstänkta. Andra avslöjande tecken som att ”svarsadressen” skiljer sig från ”frånadressen” kan också flaggas.

Fortsätt läsa kostnadsfritt!

Vi behöver bara en minut…

Så roligt att du vill fortsätta läsa våra artiklar! Det får du strax göra, utan att betala något.

- Tillgång till våra låsta artiklar och webinar gratis och utan tidsbegränsning!

Dina uppgifter delas aldrig med tredje part. Läs vår integritetspolicy här.